Sie befinden sich im Archiv von ZU|Daily.

ZU|Daily wurde in die Hauptseite in den Newsroom unter https://www.zu.de/newsroom/daily/ integriert. Die neuesten Artikel seit August 2024 werden dort veröffentlicht. Hier finden Sie das vollständige Archiv aller älteren Artikel.

Bot or Not?

Prof. Dr. Ulrike Klinger

Vertretungsprofessorin für Digitale Kommunikation

- Zur PersonProf. Dr. Ulrike Klinger

Prof. Dr. Ulrike Klinger vertritt seit September 2016 den Lehrstuhl für Kommunikationswissenschaften – Schwerpunkt Digitale Kommunikation. Mit ihren Arbeitsschwerpunkten konzentriert sie sich auf politische Kommunikation, digitale Öffentlichkeit, Demokratisierungsprozesse und Demokratiequalität und Mediensysteme im Vergleich. An die ZU „ausgeliehen“ wurde Klinger vom Institut für Publizistikwissenschaft und Medienforschung der Universität Zürich. Seit 2009 ist Klinger dort als Oberassistentin tätig, von 2013 bis 2015 war sie zudem Geschäftsführerin der Abteilung „Media und Politics“. Im Jahr 2010 legte sie ihre Promotion mit der Dissertation „Medienmonopole und defekte Demokratien: Pluralismusregulierung und Demokratiequalität in Italien und Mexiko“ an der Goethe-Universität in Frankfurt am Main ab, wo sie zuvor als wissenschaftliche Mitarbeiterin am Institut für Politikwissenschaft tätig war. Zuvor studierte sie in Frankfurt am Main und Dresden – Auslandsaufenthalte und Praktika führten sie unter anderem zur Friedrich-Ebert-Stiftung nach Mexiko-Stadt und zur Hertie-Stiftung nach Frankfurt.

- Mehr ZU|DailyPolitische Kommunikation leicht gemacht?Die Zeppelin Universität hat ein neues Forschungszentrum. Ab sofort beschäftigt sich Prof. Dr. Markus Rhomberg dort intensiv mit Politischer Kommunikation. Auf welche Bausteine er dabei setzt und was Politische Kommunikation überhaupt alles bedeutet, erklärt er im Interview.Die Revolution der NutzerDie Debatte um die neuen Medien oszilliert zwischen falschen Hoffnungen und übertriebenen Ängsten. Laut Juniorprofessor Dr. Marian Adolf kann ein Blick in sozial- und medientheoretische Grundlagen helfen, die schlimmsten Verirrungen gerade zu rücken.Nicht nur zum Fisch einwickelnBedrucktes Papier hat einen Vorteil: Man kann tote Fische nicht in iPads einwickeln. Doch das ist nicht der einzige Grund, warum Giovanni di Lorenzo fest an die Zukunft der Zeitung glaubt. Der Chefredakteur der ZEIT über Printallergie, bescheuerte Botschaften und eingebildete Krisen.

Fast harmlos wirkt der Begriff „Bot“, der vom englischen „Web Robot“ abstammt. Doch tatsächlich beschreiben die drei Buchstaben Software-Roboter, die vor allem in sozialen Netzwerken agieren und dort menschliches Verhalten imitieren, um so auf potentiell manipulative Weise mit Menschen zu interagieren. „Einmal programmiert und auf Kurs gebracht, folgen, posten und kommentieren sie unermüdlich und können so möglicherweise auch die öffentliche Meinung beeinflussen“, erklärt Klinger. Wie stark der Einsatz solcher Programme polarisiert, zeigte erst kürzlich ihr Einsatz im US-Wahlkampf. Millionen digitaler Wahlkampfhelfer sollen dort unterwegs gewesen sein: Denn Bots können massenhaft käuflich erworben und mit wenig Vorarbeit dazu genutzt werden, das öffentliche Meinungsbild in Wahlkämpfen, aber auch darüber hinaus zu verzerren.

Mit Blick auf die nahende Bundestagswahl Grund genug, das Thema auch wissenschaftlich ausführlich zu behandeln. Gemeinsam mit zwölf Masterstudierenden widmete sich Klinger über ein Semester lang aktuellen Fragestellungen der politischen Kommunikation und thematisierte dabei auch die Rolle von Bots. Doch wie ein Phänomen erforschen, dass sich mit einfachem Hinschauen kaum erkennen lässt? „Bot-Accounts lassen sich nur schwer von tatsächlichen Nutzern unterscheiden, sodass zunehmend Unklarheit darüber besteht, in welchem Ausmaß Diskurse in sozialen Netzwerken verzerrt sind“, beschreiben Klinger und die Studierenden ein grundlegendes Problem des Bot-Einsatzes.

Was manipulativ klingt, sollte für die anstehende Bundestagswahl gar nicht zur Disposition stehen. Doch ausgerechnet die umstrittene Alternative für Deutschland (AfD) kündigte im Oktober den Einsatz solcher Software-Roboter an. „Selbstverständlich werden wir Social Bots in unsere Strategie im Bundestagswahlkampf einbeziehen“, sagte Bundesvorstandsmitglied Alice Weidel dem Magazin DER SPIEGEL. Nur zwei Tage später ruderte die AfD zurück, dementierte die Aussage. Dennoch hält sich das Thema auf der politischen Tagesordnung. Lässt sich der Einsatz von Bots mit einem kurzen Dementi von der Hand weisen oder müssen wir uns auf einen neuen Trend der Wahlkampfkommunikation gefasst machen?

Laut dem Web Excellence Forum, einer Unternehmensinitiative zur Bewertung digitaler Kommunikation, sind etwa 35 Prozent aller Twitter-Accounts in den USA und 20 Prozent der Twitter-Nutzer in Europa keine Menschen, sondern Bots. „Studien haben gezeigt, dass rund ein Viertel der Twitter-Follower von Donald Trump Bots sind, dass die Brexit-Debatte maßgeblich von Bots beeinflusst wurde und auch im Ukraine-Konflikt ein ganzes Bot-Netzwerk zur Meinungsmanipulation gesponnen wurde“, erläutert Klinger den bereits massenhaften Einsatz der kleinen Computerprogramme.

Einen Blick vor die eigene Haustür wollte Klinger nun mit ihren Studierenden werfen und mögliche Bots auch unter den Twitter-Anhängern deutscher Politiker aufspüren. „Um nicht vor einer unüberschaubaren Masse an Daten zu stehen, haben wir uns im Design der Studie dafür entschieden, die Twitter-Accounts zweier Parteivorsitzender der Alternative für Deutschland und der Linken zu untersuchen“, erklären ihre Studierenden den methodischen Rahmen. Der Startschuss für das Projekt fiel bereits im September – noch vor den kontroversen Aussagen der AfD – und sollte die ZU-Studierenden über mehrere Monate hinweg begleiten. „Wir entschieden uns, sowohl eine Partei des rechten Flügels mit deutlich radikalen Tendenzen als auch eine Partei vom linken Pol des politischen Spektrums zu vergleichen. Da beide Parteien von einer Doppelspitze geführt werden, fiel die Wahl schlussendlich auf Frauke Petry und ihre 27.600 Twitter-Anhänger sowie Katja Kipping und ihre 56.500 Follower“, beschreibt Klinger das von den Studierenden selbst gestaltete Vorgehen.

Über den Web-Dienst „Birdsong Analytics“ wurde die komplette Liste der Follower beider Accounts heruntergeladen. Einer individuellen Überprüfung wurden schließlich 1.134 Accounts unterzogen – 541 Follower von Frauke Petry und 593 Anhänger von Katja Kipping. „Damit handelt es sich um eine explorative Studie, die anhand eines kleinen Samples exemplarisch überprüft, ob Bots in den Accounts dieser deutschen Politikerinnen eine Rolle spielen“, erklärt Klinger den Forschungsansatz. Um ein Bot-Urteil für jeden einzelnen Nutzer zu fällen, lernten die Studierenden die frei verfügbare Anwendung „Bot or Not“ kennen, die von der Indiana University, einer staatlichen US-Universität mit knapp 40.000 Studierenden, entwickelt wurde. „Dieses komplexe Instrument ist das Ergebnis eines Forschungsprojektes zur Identifizierung von Bots bei Twitter. Es analysiert in Echtzeit über 1.000 Merkmale eines Twitter-Nutzers – unter anderem dessen Freunde-Netzwerk, veröffentlichte oder geteilte Inhalte, linguistische und temporale Strukturen der Tweets“, erklärt eine Studierende.

Über 20 Prozent der Twitter-Follower konnten schlussendlich von „Bot or Not“ nicht ausgewertet oder erkannt werden. „Dies liegt zum einen an der Fluidität des Mediums, das jederzeit das Löschen von Inhalten oder ganzen Nutzerkonten ermöglicht. Andererseits ist auch ‚Bot or Not‘ kein perfektes Instrument – schließlich werden Bots zunehmend komplexer und lassen sich somit auch schwieriger identifizieren“, erörtert Klinger die Einschränkungen. Ein endloses Rennen scheint der Wissenschaft bevorzustehen, bei dem es die Schwächen der verfügbaren Mittel in Kauf zu nehmen gilt – und die Grenzen der eigenen Aussagen kritisch beurteilt werden müssen.

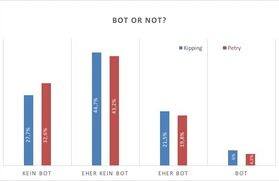

Dennoch stehen am Ende eines intensiven Semesters auch klare Ergebnisse: „Unter Frauke Petrys Twitter-Followern sind 24,3 Prozent Bots. Bei Katja Kipping sind es gar 27,5 Prozent ihrer Anhänger“, erklären Studierende und Dozentin gemeinsam. Damit kommt das Forschungsprojekt zu ähnlichen Ergebnissen wie bisherige Studien. Allerdings lohnt besonders ein genauerer Blick auf die ausgewerteten Zahlen: „Die Funktionalität von ‚Bot or Not‘ ermöglicht es, nicht nur dichotom zu codieren, sondern Wahrscheinlichkeiten genauer zu differenzieren“, führt Klinger aus. So gibt das Programm die Wahrscheinlichkeit an, mit der die jeweiligen Accounts Bots sind – die Interpretation dieser Daten bleibt der Wissenschaft überlassen. Wie das aussehen kann, reflektieren die Studierenden am eigenen Beispiel: „Schaut man nicht darauf, welche Accounts mit einer Wahrscheinlichkeit von mehr als 50 Prozent Bots sind, sondern nur darauf, welche Accounts mit einer Wahrscheinlichkeit von mindestens 75 Prozent Bots sind, dann reduziert sich die Zahl auf durchschnittlich nur noch 5 Prozent Bots.“

„Wir haben es also mit einer weiten Spannbreite von Wahrscheinlichkeiten zu tun: Die Zahl der Follower, die höchstwahrscheinlich Bots sind, bewegt sich im einstelligen Bereich. Jedoch lässt dies nicht darüber hinwegtäuschen, dass knapp ein Drittel der Follower von Katja Kipping und fast ein Viertel der Follower von Frauke Petry mit einiger Wahrscheinlichkeit Bots sind“, lautet das beunruhigende Fazit der Studierenden. Wer in kommenden Wahlkämpfen Informationen aus dem Netz bezieht und in sozialen Netzwerken hitzige Debatten austrägt, kann also jederzeit auch an intelligente Computerprogramme geraten. So warnen Klinger und ihre Studierenden: „Auch in Deutschland kommentiert und verbreitet extern gesteuerte Software aktiv politische Inhalte – und ist damit als Akteur in der politischen Kommunikation in Deutschland angekommen.“

Am Forschungsprojekt haben die ZU-Masterstudierenden (in alphabetischer Reihenfolge) Tobias Eckert, Daniela Grüßem, Katharina Sophie Held, Maximilian Höke, Christina Kößmeier, Claudia Pflüger, Léonie Rey, Julia Tauß, Britta Ulrich und Hannes Werning mitgewirkt. Das Vorhaben war Teil des Kurses „Aktuelle Fragestellungen der Kultur- und Kommunikationswissenschaften | Politische Kommunikation“ unter Leitung von Prof. Dr. Ulrike Klinger.

Titelbild:

| graphic-dreams / pixabay.com (CC0 Public Domain)

Bilder im Text:

| Pexels / pixabay.com (CC0 Public Domain)

| Cam4Heroes / flickr.com (CC0 Public Domain)

| WDnetStudio / pixabay.com (CC0 Public Domain)

| Ulrike Klinger / Zeppelin Universität (Eigene Darstellung)

Redaktionelle Umsetzung: Florian Gehm